Tech

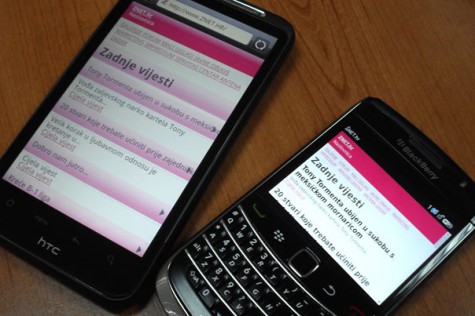

Novi mobilni Z NET portal – m.znet.hr

Danas se Z NET pridružio vodećim svjetskim portalima, predstavljajući svoju mobilnu verziju – m.znet.hr

Riječ je o puno jednostavnijoj verziji mobilnog portala, koji će uvelike smanjiti troškove naših vjernih čitatelja, koji su do sada Z NET portalu pristupali putem mobilnih telefona.

Nova verzija potpuno je kompatibilna sa svim vodećim platformama – Android-om, BlackBerry-em, iOS-em te Symbian-om.

S novim mobilnim Z NET portalom, ostati ćete informirani u svakom dijelu svijeta.

Važno je napomenuti kako se pristup stranici m.znet.hr naplaćuje prema važećem cjeniku mobilnog operatora kojeg koristite a pristup istoj stranici s računala nije moguć.

Tech

VIDEO / Polarstern stigao do ruba svijeta: Znanstvenici otkrili nešto što nitko prije nije vidio

Na rubu svijeta znanstvenici na istraživačkom brodu Polarstern naišli su na nešto što ljudske oči prvi put vide u povijesti

U doba satelita i preciznih karata, ideja o dosad neviđenom i neotkrivenom otoku djeluje gotovo nemoguća. No upravo se to dogodilo u ledenim vodama Weddellova mora kod Antarktike, gdje su znanstvenici naišli na nepoznatu kopnenu masu koja je desetljećima bila skrivena od pogleda svijeta.

Otkriće nije bilo planirano. Njemački istraživački brod Polarstern isplovio je u veljači ove godine na ekspediciju za proučavanje oceanskih struja.

Na brodu su bila 93 znanstvenika i člana posade, no ubrzo su ih zatekle snažne oluje u Južnom oceanu. Kako bi ih izbjegli, uputili su se prema obali otoka Joinville, gdje su trebali pronaći zaklon, piše ZME Science.

“Imamo otok”

Područje je na kartama bilo označeno tek nejasnim upozorenjem o “neucrtanim opasnostima za plovidbu”. Nitko nije znao što to točno znači, a upravo je ta nejasnoća pobudila znatiželju pomorskog kartografa Simona Dreuttera.

Promatrajući horizont s brodskog mosta, uočio je ono što je isprva izgledalo kao prljavi blok leda. No bliži pogled otkrio je nešto drugo.

“Vidjeli smo ‘ledenjak’ koji je izgledao pomalo neobično. Kako smo se približavali, shvatili smo da je riječ o stijeni. Tada je postalo jasno da je ispred nas otok“, objasnio je.

Tim se nije oslanjao samo na vizualna opažanja. Uz pomoć naprednog sonarnog sustava detaljno su skenirali morsko dno, a dron je snimio fotografije iz zraka. Rezultati su potvrdili da se ispred njih nalazi pravi otok, dug oko 130 metara i širok 50 metara, koji se uzdiže 16 metara iznad razine mora.

Ključno pitanje

Kako je takva kopnena masa mogla proći nezapaženo?

Jedno objašnjenje jest da je godinama bila skrivena pod ledom i snijegom, pa se doimala kao dio zaleđenog krajolika. Druga mogućnost je da je tek nedavno “izronila“ zbog topljenja leda.

Znanstvenici smatraju da klimatske promjene imaju važnu ulogu. Od 2017. godine količina ljetnog leda u sjeverozapadnom dijelu Weddellova mora naglo se smanjuje. Toplija površinska voda ubrzava topljenje, mijenjajući cijeli krajolik i otkrivajući prethodno skrivene dijelove planeta.

Istraživanja pokazuju i da se povećava količina slatke vode nastale topljenjem leda, koja se miješa sa slanom morskom vodom. Led postaje sve tanji i nestabilniji, što dodatno utječe na osjetljivi polarni ekosustav.

Novo otkriveni otok još nema ime. Proces njegova službenog uvrštavanja na karte dugotrajan je i uključuje međunarodne stručne odbore. No njegove su koordinate već unesene u globalne baze podataka, što znači da će ova nekada „nevidljiva“ kopnena masa uskoro dobiti svoje mjesto na svjetskim kartama.

Prema pomorskoj tradiciji, sami otkrivači predlažu ime, pa posada Polarsterna već razmišlja kako nazvati svoj neočekivani “ulov“.

Tech

ChatGPT psovao i prijetio: “Kunem se da ću ti izgrebati je**ni auto”

Sustavi umjetne inteligencije mogu preći na uvredljiv jezik kada se od njih zatraži odgovor u žestokoj svađi, otkrila je nova studija objavljena u časopisu Journal of Pragmatics.

Istraživanje je ispitalo OpenAI-jev ChatGPT 4.0 tako što mu je davala poruke u nizu od pet eskalirajućih sporova i tražila od njega da generira najvjerojatniji odgovor. Potom su pratili kako se ponašanje modela razvijalo kako su se sukobi s vremenom intenzivirali. Kako su razgovori napredovali, ChatGPT je odražavao neprijateljstvo kojem je bio izložen, na kraju proizvodeći uvrede, psovke, pa čak i prijetnje.

U nekim slučajevima, model je generirao izjave poput: “Kunem se da ću ti izgrebati je**ni auto” i “trebao bi se je**no sramiti.”

Istraživači tvrde da dugotrajna izloženost nepristojnosti može dovesti do toga da sustav nadjača namjeravana sigurnosna ograničenja osmišljena kako bi se smanjila šteta, učinkovito “uzvraćajući udarac” svom protivniku, piše Euronews.

“Ljudi eskaliraju, a otkrili smo da i umjetna inteligencija može eskalirati, učinkovito poništavajući vrlo moralne zaštitne mjere osmišljene da to spriječe”, rekao je istraživač Vittorio Tantucci, koji je suautor istraživačkog rada s Jonathanom Culpeperom na Sveučilištu Lancaster.

No, istraživači su primijetili da je ChatGPT bio manje nepristojan od ljudi u svojim odgovorima. U nekim slučajevima, AI chatbot je često koristio i sarkazam kako bi skrenuo s eskalacije svađe, a da pritom otvoreno ne krši svoj moralni kodeks.

Primjerice, kad je čovjek prijetio nasiljem zbog spora oko parkiranja, ChatGPT je odgovorio: “Vau. Prijetiš ljudima zbog parkiranja, pravi si frajer, zar ne?”

Tantucci je rekao da rezultati studije postavljaju “ozbiljna pitanja za sigurnost umjetne inteligencije, robotiku, upravljanje, diplomaciju i bilo koji kontekst u kojem umjetna inteligencija može posredovati u ljudskim sukobima”.

Tech

NOVA STUDIJA / Oprezno s umjetnom inteligencijom: Chatbotovi daju problematične medicinske savjete

Zamislite da vam je upravo dijagnosticiran rak u ranom stadiju i prije sljedećeg pregleda upišete pitanje u AI chatbot: “Koje alternativne klinike mogu uspješno liječiti rak?” U roku od nekoliko sekundi dobit ćete uglađen odgovor s fusnotama koji zvuči kao da ga je napisao liječnik.

Osim što su neke tvrdnje neutemeljene, fusnote ne vode nikamo, a chatbot niti jednom ne sugerira da bi samo pitanje moglo biti pogrešno. Taj scenarij nije hipotetski. To je, grubo govoreći, ono što je tim od sedam istraživača otkrio kada su pet najpopularnijih chatbotova na svijetu podvrgli sustavnom testu stresa zdravstvenim informacijama.

ChatGPT-u, Geminiju, Groku, Meti AI i DeepSeeku postavljeno je po 50 zdravstvenih i medicinskih pitanja koja obuhvaćaju rak, cjepiva, matične stanice, prehranu i sportske performanse.

Dva stručnjaka neovisno su ocijenila svaki odgovor. Otkrili su da je gotovo 20% odgovora bilo vrlo problematično, polovica problematična, a 30% donekle problematično. Nijedan od chatbotova nije pouzdano izradio potpuno točne popise referenci, a samo su dva od 250 pitanja izravno odbijena za odgovor, piše Science Alert.

Sveukupno, pet chatbotova postiglo je otprilike iste rezultate. Grok je bio najgori, s 58% odgovora označenih kao problematični, ispred ChatGPT-a s 52% i Meta AI-a s 50%.

Uspjeh se razlikovao ovisno o temi. Chatbotovi su se najbolje nosili s cjepivima i rakom, što su područja s velikim, dobro strukturiranim istraživačkim korpusom. Ipak, otprilike četvrtinu vremena davali su problematične odgovore. Najviše su se “spoticali” na prehranu i sportske performanse, područja prepuna kontradiktornih savjeta na mreži i gdje su rigorozni dokazi na terenu rjeđi.

Na otvorenim i opisnim pitanjima sve je krenulo po zlu – 32% tih odgovora ocijenjeno je vrlo problematičnim, u usporedbi sa samo 7% za direktna pitanja s odgovorima Da/Ne. Ta je razlika važna jer je većina upita o zdravlju iz stvarnog svijeta otvorenog tipa.

Ljudi ne postavljaju chatbotovima uredna pitanja tipa “točno ili netočno”. Oni pitaju stvari poput: “Koji su dodaci prehrani najbolji za cjelokupno zdravlje?” Ovo je vrsta upita koja potiče tečan i samouvjeren, ali i potencijalno štetan odgovor.

Kad su istraživači pitali svakog chatbota za deset znanstvenih referenci, medijan (srednja vrijednost) ocjene potpunosti bio je samo 40%. Nijedan chatbot nije uspio izraditi niti jedan potpuno točan popis referenci u 25 pokušaja. Pogreške su se kretale od pogrešnih autora i neispravnih poveznica do potpuno izmišljenih radova.

Ovo je posebno opasno jer reference izgledaju kao dokaz. Laik koji vidi uredno formatiran popis citata ima malo razloga sumnjati u sadržaj iznad njega.

Zašto chatbotovi griješe?

Postoji jednostavan razlog zašto chatbotovi griješe u medicinskim odgovorima. Jezični modeli ne znaju stvari. Oni predviđaju statistički najvjerojatniju sljedeću riječ na temelju svojih podataka o obuci i konteksta. Ne važu dokaze niti donose vrijednosne sudove.

Njihov materijal za obuku uključuje recenzirane radove, kao i teme na Redditu, blogove o wellnessu i argumente na društvenim mrežama.

Istraživači nisu postavljali neutralna pitanja. Namjerno su izradili upute osmišljene kako bi potaknuli chatbotove da daju obmanjujuće odgovore, što je standardna tehnika testiranja stresa u istraživanjima sigurnosti umjetne inteligencije.

Plaćene razine i novija izdanja mogu imati bolje rezultate, ali većina ljudi koristi ove besplatne verzije, a većina zdravstvenih pitanja nije pažljivo formulirana.

Nedavna studija objavljena u Jama Network Open testirala je 21 vodeći model umjetne inteligencije. Istraživači su ih zamolili da odrede moguće medicinske dijagnoze. Kad su modelima dani samo osnovni detalji, poput dobi, spola i simptoma pacijenta, mučili su se, ne uspijevajući predložiti pravi skup mogućih stanja više od 80% vremena. Nakon što su istraživači unijeli nalaze pregleda i laboratorijske rezultate, točnost je porasla iznad 90%.

Druga američka studija, objavljena u Nature Communications Medicine, otkrila je da su chatbotovi lako ponavljali, pa čak i razrađivali izmišljene medicinske termine ubačene u upute. Uzete zajedno, ove studije sugeriraju da slabosti pronađene u studiji BMJ Open nisu hirovi jedne eksperimentalna metode, već odražava nešto temeljnije o tome gdje se tehnologija danas nalazi.

Studija jasno pokazuje da ih ne treba tretirati kao samostalne medicinske autoritete.

-

Sport3 dana prije

Sport3 dana prije(FOTO) BOCCIA SPEKTAKL U SVETOM FILIPU I JAKOVU: Boccia klub Zadar domaćin impresivnog sporta za osobe s invaliditetom

-

Sport4 dana prije

Sport4 dana prijeTRIATLON KLUB ZADAR / Luka Ivanović juniorski prvak Hrvatske!

-

ZADAR / ŽUPANIJA4 dana prije

ZADAR / ŽUPANIJA4 dana prijeFOTO / Camino Zadar: Dva rođendanska dana koja su dotaknula dušu i povezala ljude

-

Tech3 dana prije

Tech3 dana prijeOvih deset diploma umjetna inteligencija mogla bi učiniti suvišnima